Owli-AI 研究

An Electronic Guide Dog for the Blind based on Artificial Neural Networks

(2021) - Paper

S. Lopatin; F. v. Zabiensky; M. Kreutzer; K. Rinn; D. Bienhaus

Technische Hochschule Mittelhessen, University of Applied Sciences, Institute of Technology and Computer Science, Giessen, Germany

このページは機械翻訳で、現在編集レビュー前です。

ビジュアル

概要

この論文は、公共空間での定位と移動を支援する電子支援システムの実現可能性 を示しています。中核となるアプローチは、ゼロから学習したニューラルネット ワークによる意味論的セグメンテーションを用いて、歩行可能な歩道領域を光学 的に検出することです。実装では、NVIDIA Jetson Nano をモバイル計算ユニット として用い、オンデバイス推論を実現しています。検出した歩道構造からナビ ゲーション情報を導き、音声出力として利用者に提示します。これにより、本研究 はコンピュータビジョンと CNN に基づく携帯型 Electronic Guide Dog の技術的実現 可能性を検証しています。

キーワード

- electronic travel aid

- blind sidewalk detection

- portable ETA system

- electronic travel aid technology

- computer vision

- convolutional neural network

ダウンロード

図版

論文内のビジュアル 7 点。

-

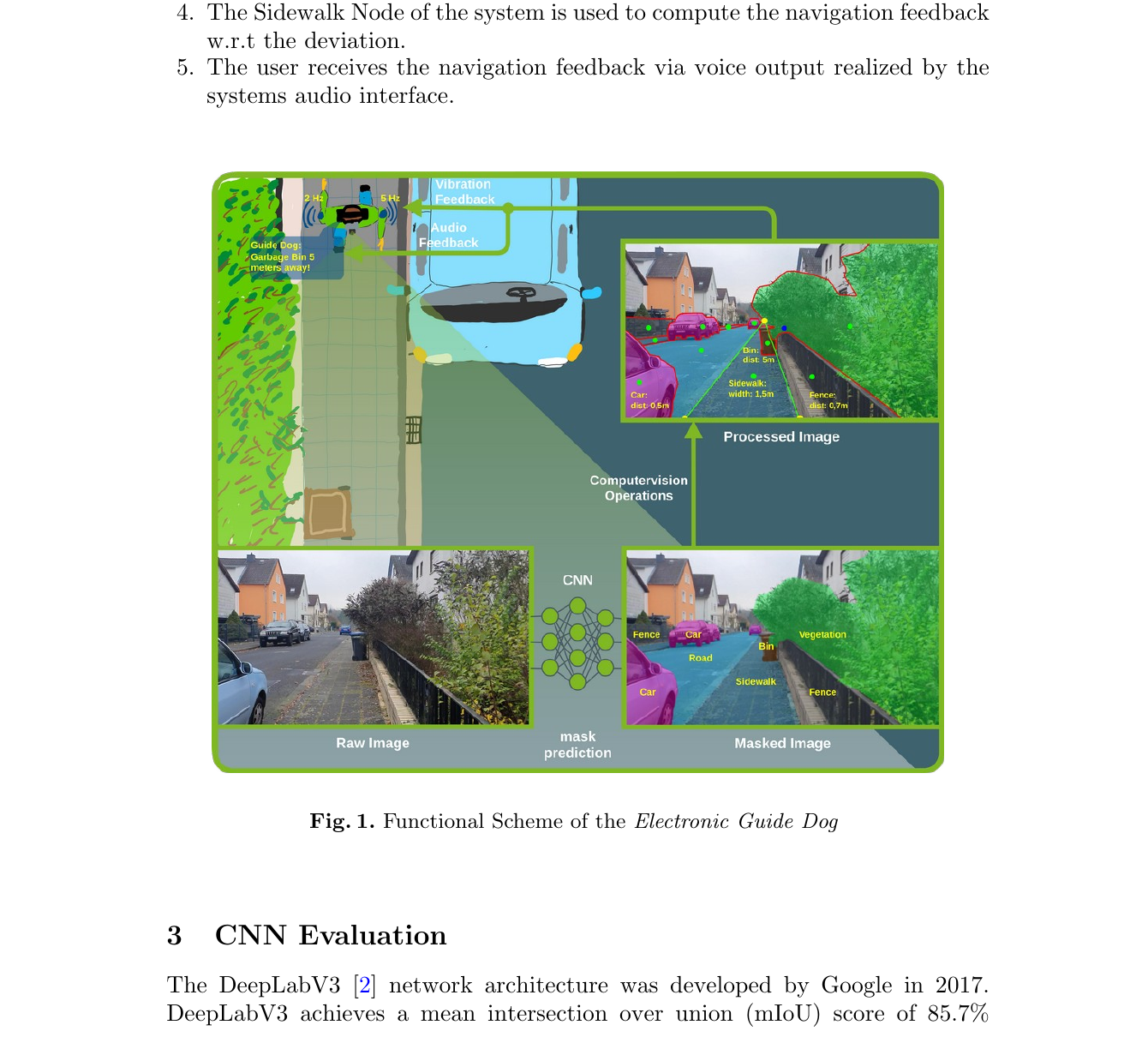

Fig. 1 Electronic Guide Dog の機能構成。 -

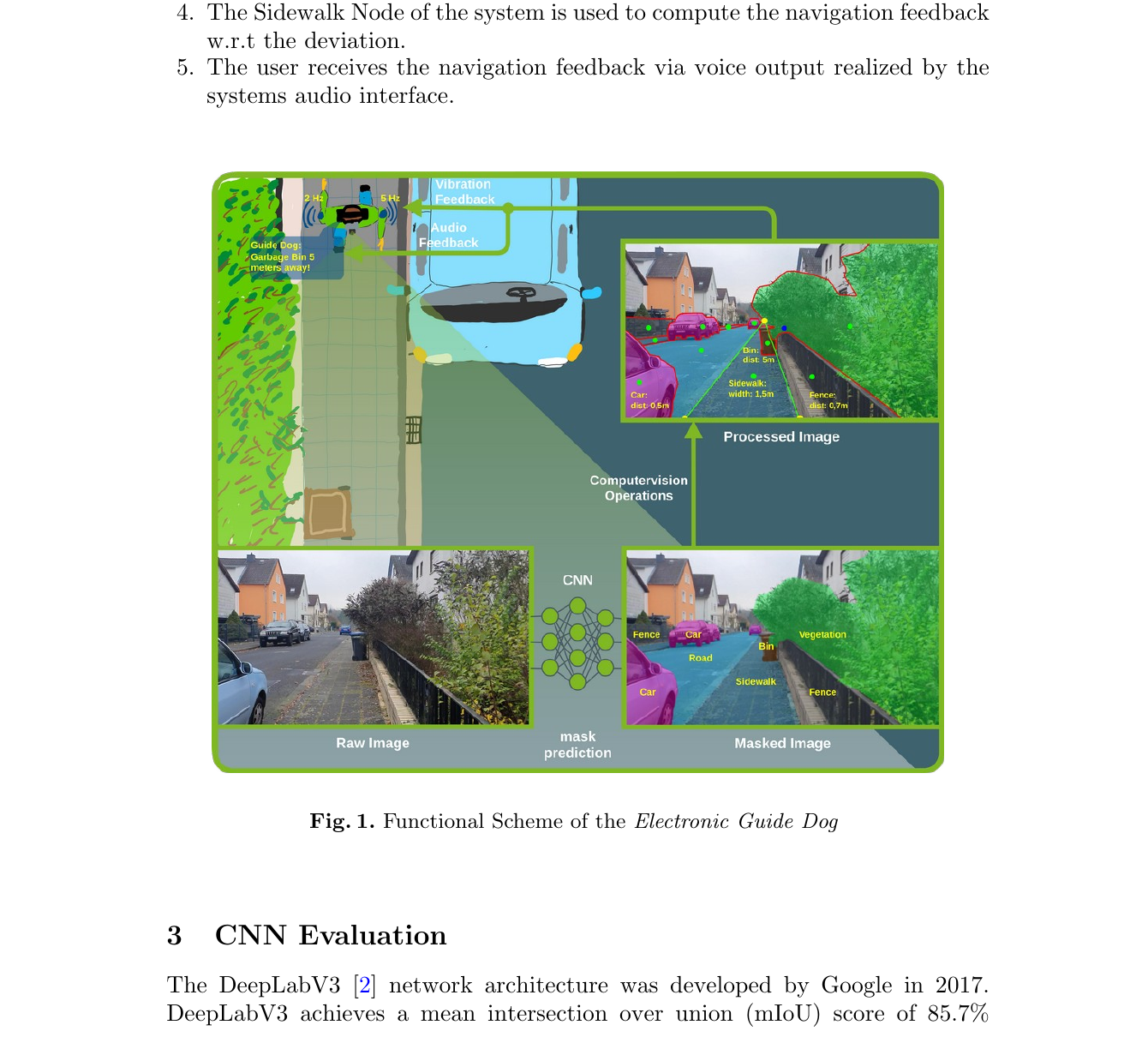

Fig. 2 データフロー型システムアーキテクチャ。 -

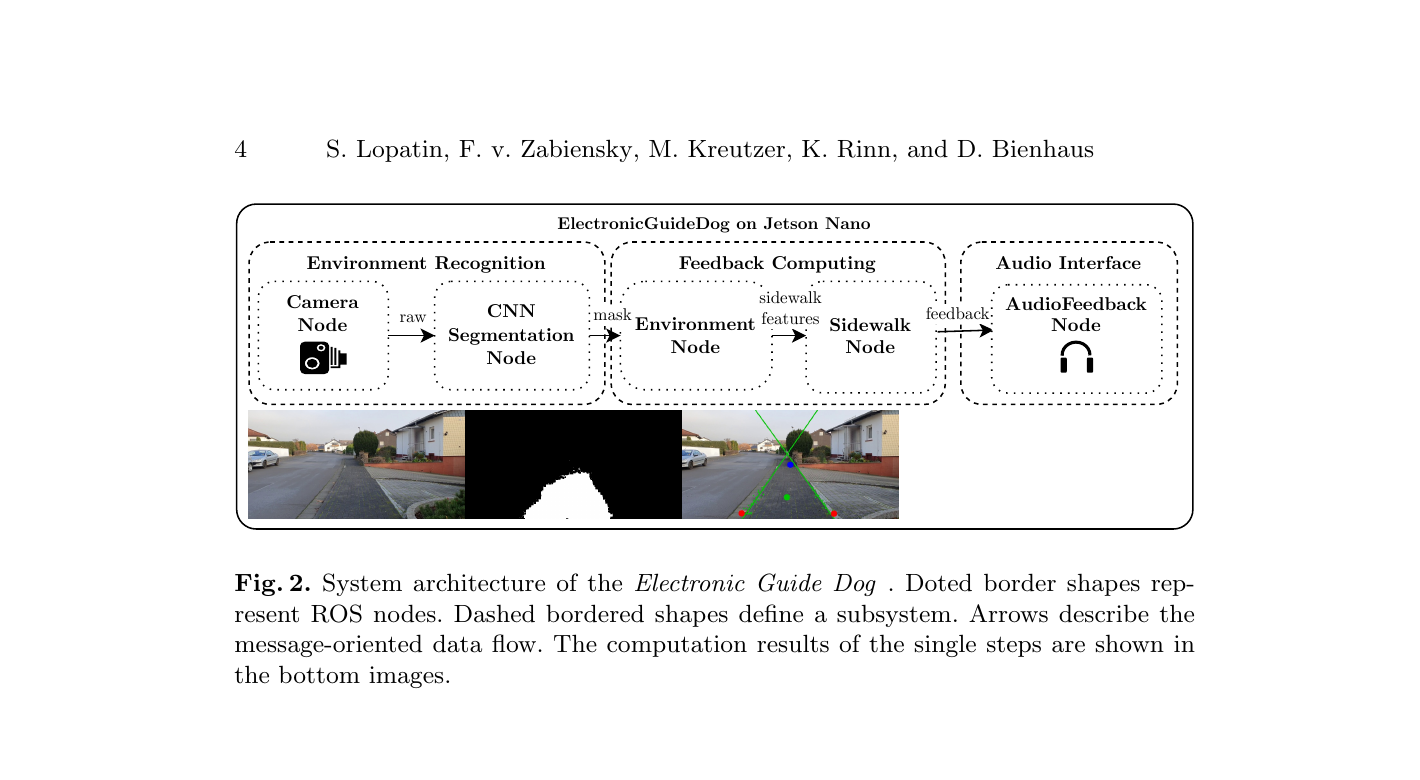

Fig. 3 速度と精度の比較。 -

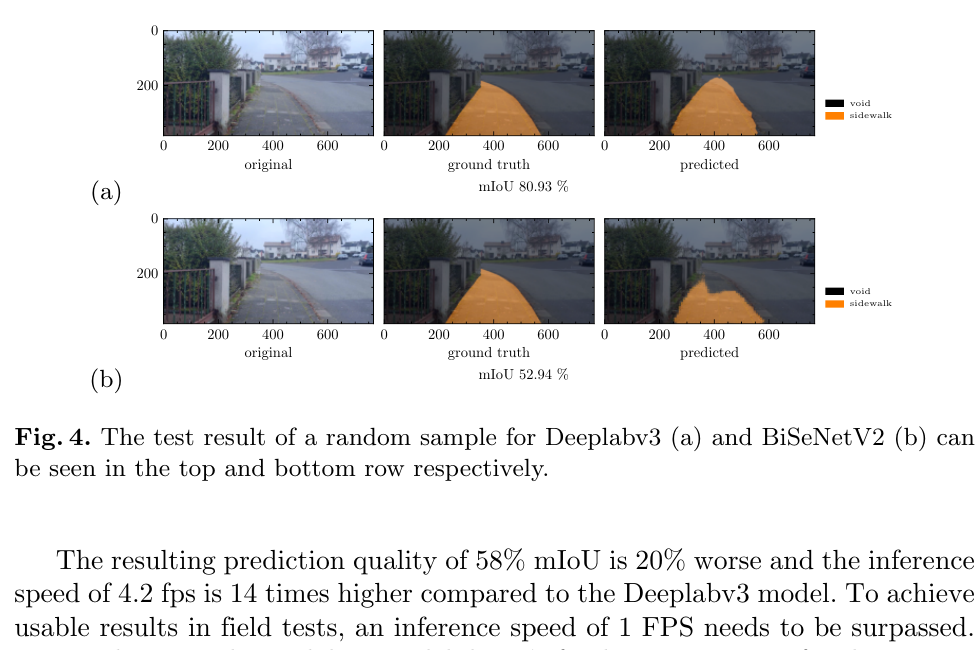

Fig. 4 DeepLabV3 と BiSeNetV2 の比較例。 -

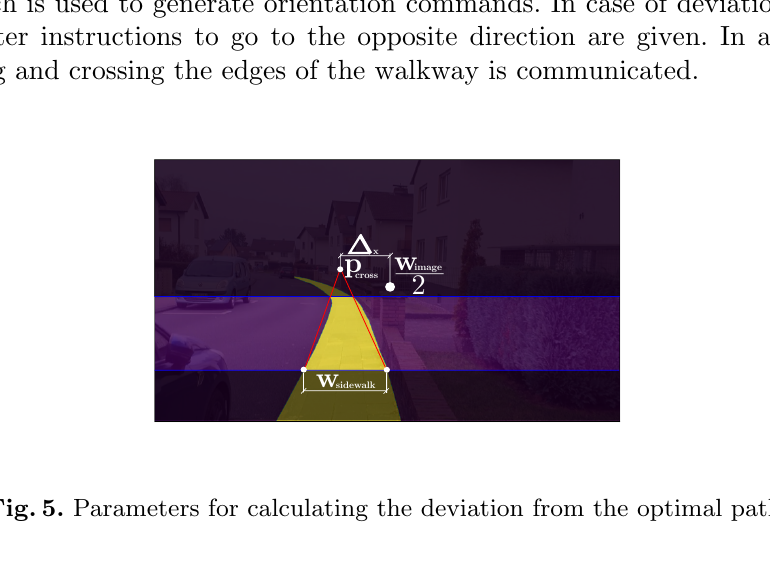

Fig. 5 最適経路からの偏差計算パラメータ。 -

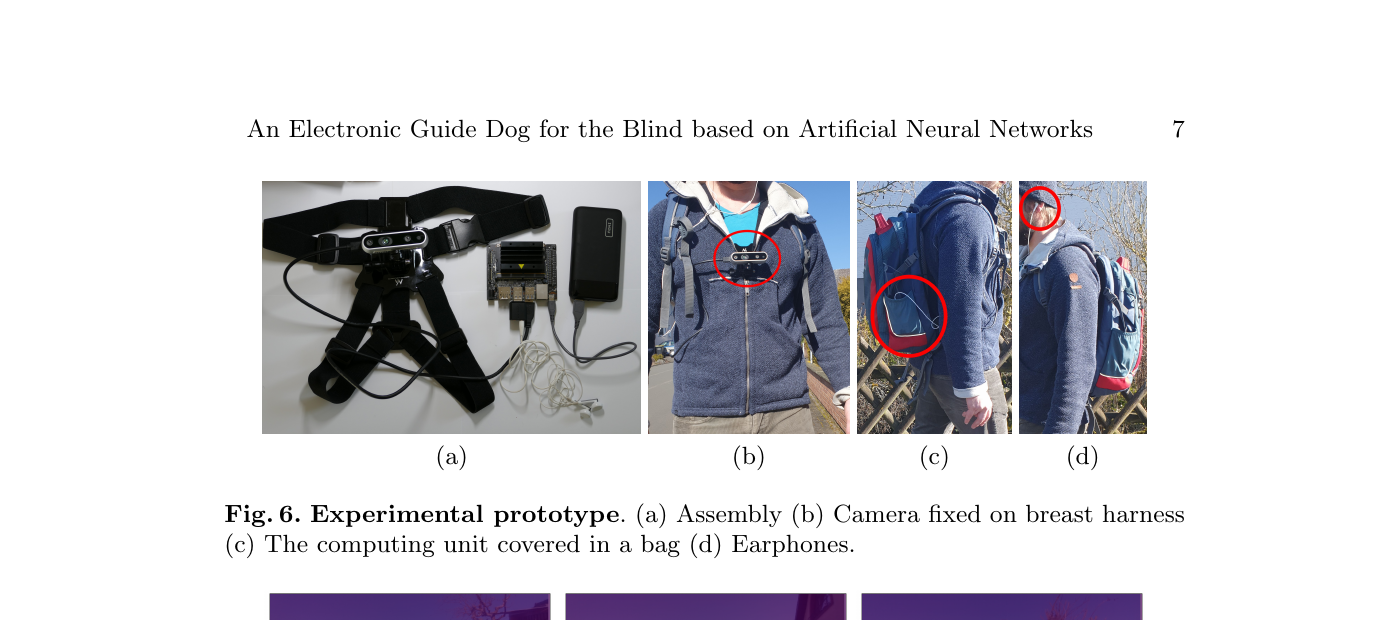

Fig. 6 フィールドテスト用の実験プロトタイプ。 -

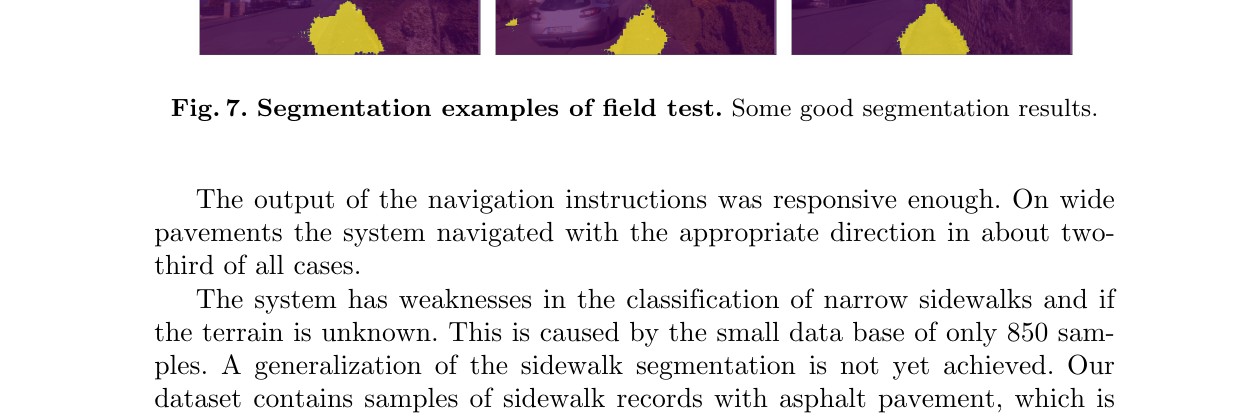

Fig. 7 フィールドテストのセグメンテーション例。